Ly²ka Code | Design by Nature

Team Updates

Este es el repositorio en el cual se manejaron los algoritmos de búsqueda y de planificación para la trayectoria de LYKA.

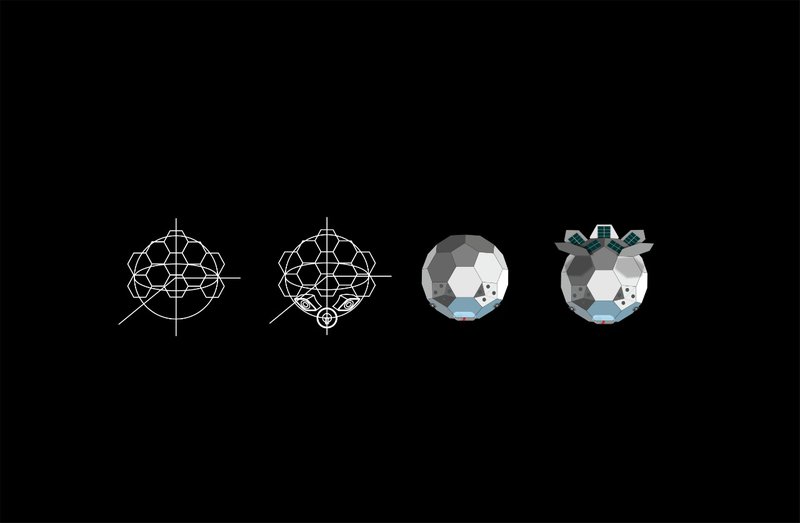

Ly²ka for MMOD Inspection

Robot con forma de icosaedro truncado inspirado en un panal de abejas, con ocho propulsores, 6 grados de libertad, capaz de inspeccionar cualquier nave utilizando redes neuronales multicapa con algoritmos de “backpropagation” para la detección de fallas ocasionadas por la colisión de micrometeoritos (MMOD) y basura espacial; grafos con el algoritmo de “hamiltonian path cycle” para recorrer la nave.

Objetivos

- Inspeccionar la superficie o casco de una aeronave.

- Crear un “flyer” capaz de navegar de manera autónoma alrededor de una aeronave.

- Diseñar un algoritmo de navegación que optimice los recursos.

DESCRIPCIÓN DEL FUNCIONAMIENTO

Ly²ka es un robot autónomo el cual contiene un puerto de carga (docking point) que se encuentra dentro de la nave. En este punto el robot podrá cargar su batería de iones de litio, además de cargar el combustible para los propulsores. Existirá un panel de control en donde el usuario podrá visualizar el movimiento en tiempo real del robot y colocar algunos de los parámetros necesarios para obtener los resultados deseadas, tales como: frecuencia de inspección de la nave, velocidad del robot, control remoto del mismo, entre otros.

Una vez establecido dichos parámetros, el robot ejecutará el algoritmo de “hamiltonian path cycle” para recorrer la nave. Con el giroscopio, gps y sensores de proximidad será capaz de moverse a una distancia prudente mayor de 15 pulgadas de la nave espacial.

Se iniciara el proceso de escaneo de la nave con la tecnología LIDAR. Se obtendrá un modelo en 3d de la nave con la información de la distancia de todos los puntos de la nave. Esta información será comparada con información previamente agregada al sistema para determinar si existen cambios del mismo. Este proceso lo realizará el robot con un procesador basado en la tecnología FPGA. Si se ha encontrado algún agujero en la superficie de la nave el robot lo detectará y volverá a escanear solo el área afectada con la una cámara hiperespectral.

La camara hiperespectral nos ayudara a determinar e identificar las capas de recubrimiento de la nave que han sido afectadas, ya que se podrá visualizar con mayor detalles el daño que con una cámara RGB normal. El área afectada se marcará en el mapa de la nave y será observada desde el panel de control. Dicha información es enviada a través de un emisor de ondas de radio de baja frecuencia. La imágenes hiperespectrales son guardadas dentro de una memoria del robot, pero estas no serán procesadas en el mismo. Esta información se envía a la base del robot el cual contiene un microprocesador para las imágenes y detectar el tamaño del agujero y las capas de recubrimiento de la nave.

El robot posee una cámara “Hazard Cámaras” que detectará si un objeto, ya sea basura espacial o micrometeoritos se están acercando al robot. El control “feedforward” ayudará al robot a reaccionar y moverse para esquivar los objetos, así mismo si el robot se está acercando mucho a partes de la nave, este podrá tomar la decisión y generar una nueva ruta para esquivarlo.

Si el robot llegase a alejarse demasiado de la nave y se queda sin batería, este desplegará paneles solares que están en la parte superior del robot para cargar la batería interna y poder regresar a su base.

COMPONENTES

Detección de fallos:

- Sensor LIDAR para escanear los daños causados a través de la creación de una nube de puntos que serán procesados en tiempo real utilizando una red neuronal multicapa con el algoritmo de “backpropagation” para así aprender con las inspecciones anteriores y evitar levantar falsos positivos o fallas que ya fueron reparadas.

- Cámara Hiperespectral, una vez encontrado el daño, ayudará a determinar el área del daño haciendo un barrido por la superficie creando imágenes a diferentes longitudes de onda y resaltar detalles el orificio.

- Cámara de Navegación (NavCam) para visualizar en tiempo real lo que ve Ly²ka.

Cinemática:

- 8 propulsores de efecto hall para realizar los movimientos de yaw, pitch, roll, and throttle.

- 6 “Hazard Cámaras” montadas a 120° de separación para evitar choques frentes a obstáculos inesperados a través de un control “FeedForward”.

- Giroscopio de fibra óptica y GPS para tomar datos reales de las posiciones de rotación y traslación.

- Sensor de velocidad.

Comunicación:

- Receptor y Emisor de ondas de radio de baja frecuencia para enviar y recibir los datos hacia el “docking point” para el procesamiento de los datos.

Autonomía:

- Tecnología FPGA en Ly²ka que procesa los datos recibidos desde el “docking point” y a su vez controla los datos recibidos por los sensores.

- El “docking point” es la estación base dentro de la nave que sirve como punto de carga y procesamiento de los datos e imágenes recibidos por Ly²ka, además encargado de generar el algoritmo de camino de Hamilton y enviarlo a Ly²ka para recorrer toda la nave.

- Paneles Solares dispuestos sobre la superficie del flyer que se desplegaran en caso de emergencia, utilizar esa energía para alimentar a las baterías y regresar a la nave.

- Baterías de iones de litio recargables para el funcionamiento de los propulsores.

- Sensor de temperatura para medir temperatura interna del flyer.

SpaceApps is a NASA incubator innovation program.